和人脑一样,电脑也会上当受骗。比如操控无人驾驶汽车的电脑会把随意的涂鸦当作火车、围栏甚至校车。我们一直以为,人类是无法弄明白这些涂鸦是怎么蒙蔽电脑的,但是约翰·霍普金斯大学的研究人员发现情况并非如此——其实大多数人可以做到。

研究发现,电脑与人脑的差异可能并没有我们想象的那么大,人工智能的飞速发展使得人类与机器在视觉能力上的差距持续减小。这项研究在上个月发表在《自然-通讯》上。

“多数情况下,这个领域的研究都是围绕着如何使电脑像人一样思考。我们的项目恰恰相反——我们追问的是人能否像电脑一样思考。”文章的通讯作者、约翰·霍普金斯大学心理学与脑科学学院助理教授 Chaz Firestone 说。

通常人类觉得轻而易举的事情对电脑而言很难。虽然人工智能系统在数学计算及记忆大量信息方面早已胜过人类;然而在过去的数十年中,人类在识别日常物品——比如狗、猫、桌子或椅子——方面依然保持了优势。

不过最近,模仿大脑的“神经网络”已渐渐具备人类识别物品的能力,由此带来的技术进步可以支持无人驾驶汽车与人脸识别项目、以及帮助医生发现放射影像中的病变。

然而即便有了这些技术进步,仍然存在一个关键的盲点:有人可能故意制造不能被神经网络正确识别的图像。这些“有敌意的”或“开玩笑的”图像就成为一个大问题:不仅因为它们会被黑客利用来制造安全风险,而且它也说明了人类和机器识别图像的方式实际上非常不同。

在一些情况下,想让电脑把苹果认成汽车,只需重新设置一两个像素。在另一些情况下,机器会在并无实际意义的电视雪花图案中认出犰狳和面包圈。

“这些机器错认物品的方式似乎是人类永远不会采取的,”Firestone 说。“但令人惊讶的是,并没有人真的去验证这一点。那我们又怎么会知道,人无法看到电脑看到的事物呢?”

为了检验这一论断,Firestone 和 Zhenglong Zhou(论文的第一作者、约翰·霍普金斯大学认知科学专业)要求参加测试的人“像机器一样思考”。

机器在命名图片时可用的词汇量相对很小。所以,Firestone 和 Zhou 向被试展示了几十张具有欺骗性的图片,这些图片已经骗过了电脑,同时他们给被试的标签选项也和给电脑的标签选项一样。

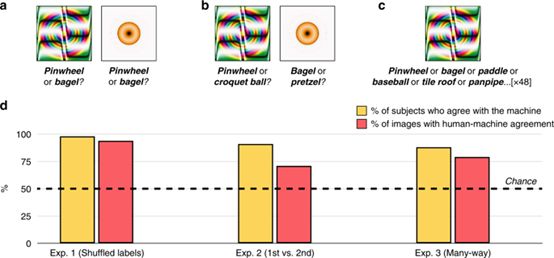

他们还特别询问了被试,两个选项中哪个是机器的判断结果——其中一个是实际结果而另一个是随机答案。(图中的斑点是面包圈还是纸风车?)结果显示,被试与电脑的选择高度一致。

在75%的情况下,被测试人都选择了与计算机同样的答案。更为显著的是,98%的被测试人倾向于像计算机一样答题。

接下来,研究者提高了筹码,要求被测试人选出电脑的最优答案和次优猜测。(图中的斑点是面包圈还是蝴蝶脆饼?)人又一次证实了电脑的选择,91% 的被测试人猜中了机器的首选答案。

甚至当研究人员让被测试人从 48 个选项中答案时,或者当测试图片像电视雪花图案一样时,大部分被测试人也能选中机器的选项。在这些花样繁多的实验中,共有 1800 名对象接受了测试。

▲研究人员进行的多组实验及结果。

“我们发现如果你把一个人和电脑放入同样的情景中,人类就很容易得出与机器一样的结论,”Firestone 说。“对人工智能来说这仍然是一个问题,但是我们现在知道,电脑的识别方式并非是人类完全不会采用的。”

编辑:李晨琰

责任编辑:唐闻佳

来源:综合自科研圈、《自然-通讯》杂志等