12月9日,华人科学家、荷兰阿姆斯特丹自由大学教授黄智生在北京大学“博古睿讲座”中主讲“人工智能与精神健康”

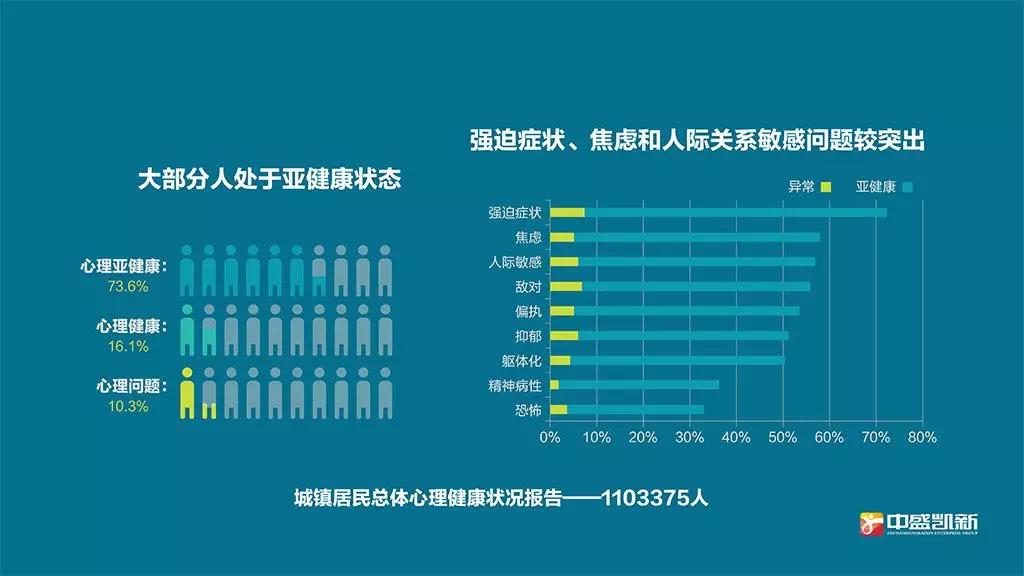

《中国城镇居民心理健康白皮书》数据显示,当前中国城镇居民73.6%处于心理亚健康状态,16.1%存在不同程度心理问题,心理健康的人仅占比10.3%。与此同时,自杀已成为我国15岁到34岁青少年人群死亡的主要原因。曾主持欧盟第七框架语义技术重大项目的华人科学家、荷兰阿姆斯特丹自由大学教授黄智生发现中国网络社交平台(如微博)成为当下许多自杀倾向者吐露心声的“现代树洞”。2018年7月25日,他发起的识别微博“树洞”信息的第一代树洞智能机器人AI001号诞生,至今“树洞机器人”已发展到第六代,成功救助1094位自杀者。人工智能如何实施自杀干预?这项新技术目前面临哪些风险和困境?未来人工智能能够完全代替人工实施精神救助吗?带着这些问题,日前,文汇讲堂在北京大学“博古睿讲座”后专访黄智生,对话人工智能救助生命的现在与未来。

人工智能技术适用于探索复杂的自杀人群的认知结构

文汇讲堂:您在开发“树洞”救援机器人时应用“语义技术与知识图谱”这一人工智能技术,为何这一技术能够最快速、最准确的找到“树洞”中的自杀倾向者?至今救下的1094人是幸运者,您的这一概念是如何实施的?实施的现状如何?

黄智生:人工智能本身就是一门应用型的学科,空谈逻辑推理和理论是没有实际价值和作用的,我们首先要考虑的是如何为社会服务。健康和医疗是我们最先关注的领域,而精神健康越来越重要。于是,我们关注到了抑郁症。

我查阅国内外自杀手册,发现里面有各种各样的自杀方式分类。我从中提取自杀方式和自杀计划相关概念存入“树洞”知识图谱。除此之外,“树洞”知识图谱还覆盖痛苦表达、时间描述、地点描述等相关概念的描述。其中有几条基本要领:越紧迫越危险、越具体越危险、时间越临近越危险。由此,自杀风险分级标准也得以明确,按照风险层级从低到高,共分为十级,六级以上须每日通报。与此前通过关键字搜索进行选定的传统技术不同,知识图谱能够让机器理解人类使用的自然语言,并根据需求精确锁定具有特定含义的语句,其准确性更高,更能够应对关键字搜索无法处理的复杂问题。1分钟的信息检索、筛查过程,树洞机器人能够滤掉99%的不相关信息,辨认出含有自杀方式和时间的词语,与储存在AI知识库中的文本比对,然后输出符合的配对结果。

语义距离计算是人工智能领域判断两个概念或者两个陈述相关性的一种技术方法。目前,我们在考虑使用这种技术来分析、论证和评估对自杀倾向者说服力的程度。这种方法仍然在研究之中。这项技术方法不仅仅可用于自杀的心理疏导,还可用于抑郁症患者的认知结构分析,甚至可用于人际关系的心理疏导分析。许多人对自杀者如此决然地选择自杀这样一个反生物本能的做法深感困惑。当我们深入地了解到他们的认知结构后,就会发现在这样一个“生与死”的问题上,这些企图自杀者实际上想得比任何旁人都要多。选择自杀对他们来说总是会被论证成是一个明智的选择。我们经常会发现要改变他们的思维实际上是一个很大的挑战。有效的自杀心理疏导必须从他们的认知结构分析出发。语义技术可以帮助进行认知结构的深度分析,理解“自杀的认知模型”。

2018年公布的《中国城镇居民心理健康白皮书》数据显示我国九成居民心理亚健康或存在不同程度的心理问题

AI提高了自杀监控效率,24小时工作变被动为主动救助

文汇讲堂:据了解,facebook公司也在做AI自杀干预的应用,看起来人工智能实施自杀救助是未来发展的趋势,依据您的实践经验,人工智能实施抑郁症自杀救助与传统的救助方式相比,优势在哪里?困难在哪里?

黄智生:人工智能能够为精神健康做非常多的事情,例如,大数据分析、认知结构分析、聊天机器人、网络监控、危机干预、精神监控时空特征分析等,自杀救助是我的人工智能团队关注到的首要问题,因为这是精神健康救助最为紧迫的问题。人工智能“树洞救援”的目标是实现一个智能主体,能够巡视各种社交媒体, 发现高风险的自杀人群。通过对相关信息的分析,找到可能自杀人身边的亲人和好友,进行预警,并采取相应的行动,把即将要自杀的人从死亡线的边缘拉回来。

传统的自杀干预往往是被动干预,通常依靠自杀者主动寻求帮助才能获得及时救助。然而,由于许多患者对抑郁症有病耻感,社会上有许多人对抑郁症有许多误解和偏见,使得许多抑郁症患者不积极主动寻找治疗方式,而是偷偷通过网络寻找自己的解决方法。这往往会使他们错失最好的治疗机会而增加了许多绝望的情绪。我们通过人工智能监测社交媒体中的“树洞”可以主动地发现他们,给他们提供帮助。这与传统的自杀救助方式相比,具有明显的优越性。此外,人工智能提高了自杀监控的效率,它能够24小时全时段监控,自动计算自杀风险,全自动生成监控通报,这些都是人工难以完成的。

AI主要发现隐蔽的自杀者,“树洞救援”需规范化和专业化

保护自杀倾向者的隐私和通过网络找到他们阻止自杀之间的矛盾,是目前我们面临的一大困难。我们采集的都是网络公开数据,没有涉及到个人隐私。对于高自杀风险的人,我们需要对大量的公开数据作解读,以获得当事人的真实身份的信息。我们经常是通过同当事人交朋友,在获得他们的同意帮助的情况下才进行的。Facebook由于掌握了客户的个人信息,所以,他们作自杀干预要比我们容易得多。此外,人工智能实施自杀救助还面临专业化、法律保障、技术伦理风险等诸多问题。当然,缺乏足够人力投入也是目前我们所面临的巨大困难。人工智能当下还是实施自杀干预的辅助手段,它的功能主要是发现隐藏起来的自杀者,对于欲自杀者的心理疏导等具体救助的工作还需要依靠人力,特别是专业人士。我期待人工智能的自杀救助能在社会多方努力下更加规范化和专业化。

2012年3月18日,南京某高校的一名女大学生在距离毕业答辩还有一周时,在其微博(走饭)留下“轻描淡写”地33个字,第二天自杀离世,走饭微博下的留言成为自杀者倾诉的网络“树洞”

长期而言,人工智能无法代替自然人以“细致的爱”干预自杀

文汇讲堂:现在您所开发的最新一代的AI006机器人主要功能是发现自杀倾向并向树洞救援团发出警报,实施自杀救援行动需要依靠现实人力。您对人工智能实施自杀干预进一步的发展有什么样的预期?在您看来,人工智能是否会有一天完全代替自然人实施自杀干预?

黄智生:如上所述,实施精神健康救助的人力开销是巨大的,我们期待人工智能能够代替一些人工干预的枯燥工作。目前,我的团队正在开发实施自杀干预的聊天机器人,期待它们能够代替自然人的部分陪伴和疏导工作。另外,我们当下监测的网络“树洞”有限,这主要是由于人力不足,无法负担更多的救助需求。我期待更多的人加入“树洞救援团”,在人力充足的情况下可以扩大监测范围。

在目前的技术条件下,人工智能完全代替自然人实施自杀干预还为时过早。上面我谈到过人工智能“树洞救援”的目标是“运用智能主体找到可能自杀的人”,但在具体的救援行动中,我们认识到这一目标的实现对于挽救自杀者的生命来说远远不够,也就是说完全依靠人工智能还不足以救助自杀者。用细致的爱把自杀倾向者从死亡线上拉上来才是有效的,在这一点上,人工智能还无法代替自然人。

黄智生教授介绍,“树洞救援团”志愿者团体最早由几十位高校学者组成,目前发展为500人左右,其中40%是心理咨询师、精神科医生等专业人士

AI发现每天有200人需帮助,公益救援在政府投入后或可创造就业

文汇讲堂:您致力于运用人工智能的技术拯救生命,近年来,在生命哲学领域的探讨中,有观点认为人工智能的发展会对人类未来的生命状态造成威胁。例如,人工智能取代自然人的工作而造成的失业问题,人工智能与生物工程相结合改变自然人的基因问题等。您如何看待这样的担忧?

黄智生:我对人工智能的未来比较乐观,至少在现有的技术条件下不会对人类的生命状态造成威胁。人工智能的普及并不会造成巨大的失业,反而会创造更多的就业机会。就拿树洞救援来说吧,由于采用人工智能技术发现每天有200人需要帮助,每一个受助者都需要一个救援小组,至少需要5个人。这样一个高品质的救援工作每天都需要投入1000人左右。由于陪伴工作是长期的任务,三个月多就需要我们投入十万人力才能满足需要。如果能够看到这方面工作对社会稳定和家庭幸福都很重要的话,这项工作的专业化和系统化可能带来新的就业机会。正如我所说,人工智能是应用科学,它代替人工去做一些单调枯燥或耗费时间的工作。

当然,我对人工智能的未来持乐观态度并不是认为它不存在风险,在发展新技术时仍需要警惕。但我相信人类有能力在控制风险的范围内推进这项技术,至少目前看来,人工智能对未来生命的威胁还是还遥远的事情,不必过于担心。

作者:黄智生 刘梦慈

现场摄影:刘梦慈

编辑:李念 刘梦慈

责任编辑:刘梦慈

*文汇独家稿件,转载请注明出处。